【記者李容珍/採訪報導】隨著生成式AI的發展,各種人工智慧的運用,包括與人對談、生成圖片和寫程式等功能陸續發展,大幅改變生活樣貌;近期Open AI新開發AI模型Sora能生成長達一分鐘的影片且難辨真假,震撼全球、引發熱議。

台大名譽教授、資工系兼任教授歐陽明表示說,ChatGPT4的社會化,是一種學習文字接龍技術,後來被運用在Sora,只是不再是文字接龍,而是影像方塊接龍,從上到下、從左到右切成不同區塊,每一秒鐘30張,每張再拆切成一小塊,最重要的是要有更多可以運算的資源,可有效提升效果。

Sora為影像方塊接龍 無法處理陰影不一致

為了能產生動畫,除了運用Transformer技術之外,也運用re-captioning技術,使之能夠影像化、文字化。譬如一個人走在下雪的東京,要把這段話變成動畫,可以加註一個人走在東京街頭,旁邊都是高樓大廈,很多行人走在路上,這人是中年男子,就會形成30秒到1分鐘的動畫。

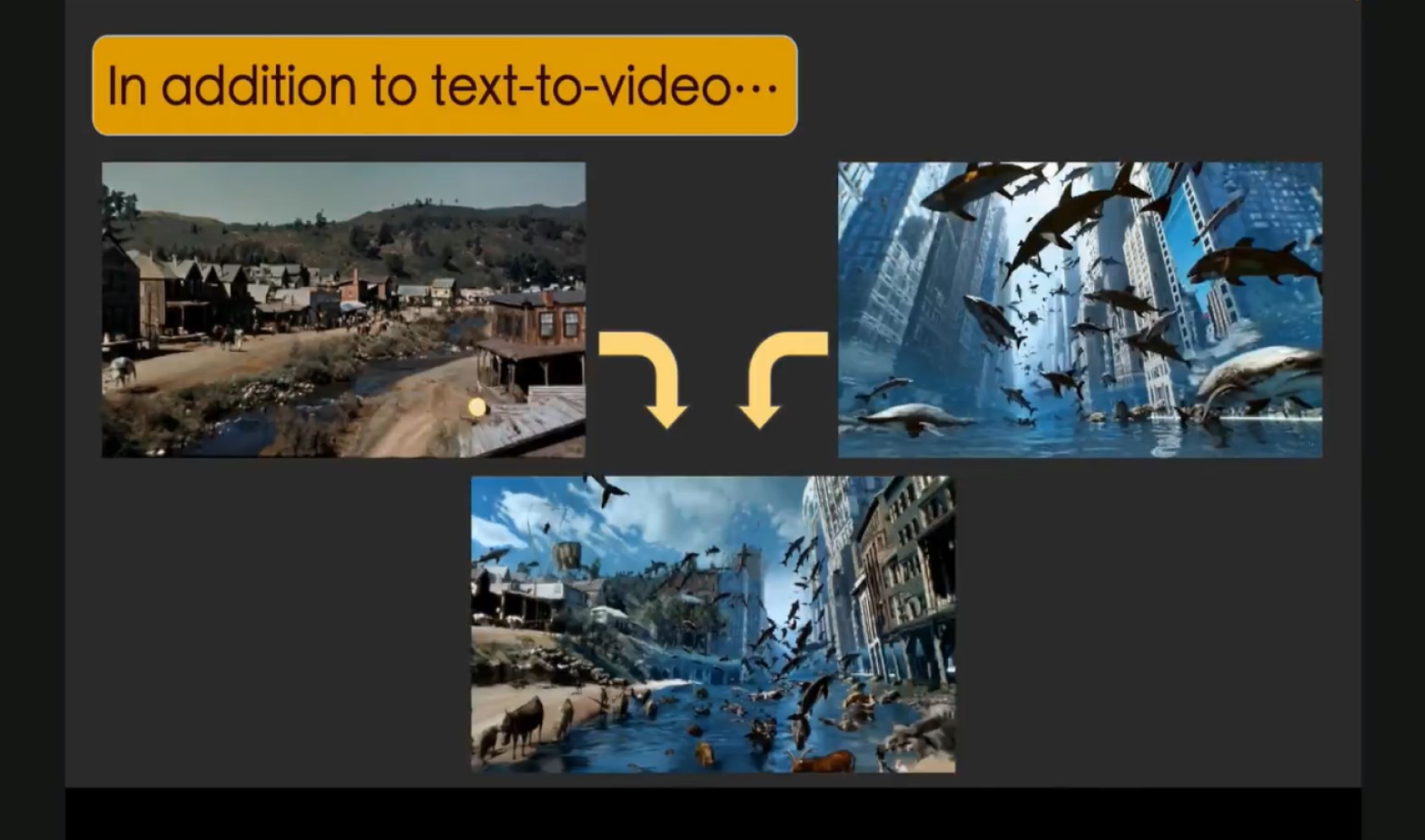

他說,Sora透過大量資料學習,從YouTube及人類的文字,還可以從軟體工具產生的許多影像,包括虛擬城市、網路遊戲。當資料從1倍到4倍,加增到32倍大,產生的影像品質就會不同。由於ChatGPT可以做文字接龍和影像接龍,所以兩個Video畫面影像可以合成在一起,譬如一張城市和另一張虛擬城市可以連結合成一起。

為讓人能分辨真假,他建議用真實的錄影附加資料,如手機的時間、地點、手機型號。他也提到,「Sora無法處理陰影不一致的問題」,例如大量風景人物、房舍,若有太陽或燈光照明,陰影應該一致,若是陰影忽東忽西,則表示影片是錯誤的。影片內若有文字的問題,例如,會出現好像中文字的廣告牌 旗子,其實是不存在的字。

類似影片確實難辨真偽

Sora如果被拿來生成假消息該怎麼辦?據了解,Sora尚未開放一般民眾使用, OpenAI官網也提到,目前正與各界合作防範安全問題。

歐陽明教授也坦言,如果放兩段類似的Video,讓人猜測何者為真?基本上,他也只能猜對一半。至於Sora會帶來那些安全問題和衝擊,當如何防範?他表示,這與人們看待Deepfake(深偽技術)的對應方式相同。

歐陽明教授表示,早在20年前,就有政治人物製造假消息,雖然選後證明是造假,但是所造成的結果已經無法挽回。不管網路或AI真假消息,只要與自己立場相同,都容易「深信不疑」很難改變,這是網路「政治同溫層效應」,甚至有幾萬、幾十萬人都會支持這樣的想法。因此,政治人物為了勝出,有可能運用AI技術製造假新聞,屆時不可能知道是誰做的,一時之間也難知真假,若造成選舉反轉,即使後來花時間查出是造假,也已經來不及了,而且也沒有人站出來道歉。

所以,當我們看同一件事情就會看出兩種完全不同的結果。他曾經在美國波士頓科學博物館看一座臉部雕像的科學實驗。讓他驚訝的是,在10公尺外看,栩栩如生,但若再走近幾公尺,看見雕像的鼻子是凹進去的,再往後退幾公尺,這個人鼻子卻是凸出來的。

歐陽明教授表示,這個在電腦視覺上,叫做illusion。「人類的感官、聲音,可以被人類的大腦所主宰,而拒絕看到事情的另外一面」,因此人在那個環境裡面,就只會相信自己的大腦所告知的訊息,這也是「同溫層現象」,影響非常大,而且是有科學根據的。

為避免被假消息誤導,他一些同事會去聽不同立場的新聞觀點和廣播,若有外語能力,聽同一件事的英文廣播或日文廣播,不會只聽信單一的說法。基督徒的優點是可以禱告求神,賜給我們智慧的判斷,幫助我們看見事情的真相。

如同一把刀的兩面 可利己也可害人

Sora的出現,他認為,應該是讓人類使用變得更方便。但是,如同一把刀的兩面,就看我們如何用它。

對於Sora安全的疑慮,發表過許多相關論文的美國史丹福大學電腦科學家李飛飛教授,著有暢銷書《電腦科學家李飛飛的視界之旅》,她對Sora的研究非常擔心,其中一個就是安全和真假的問題。連OpenAI 執行長山姆.阿特曼(Sam Altman)也無法預測未來AI會變成什麼樣子。

「人工智慧是machine learning,是一種學習的機器」,簡單來說,它就像是個小小孩,我們可以一直教它東西,但是不太能夠預測它能夠學到什麼東西,或是怎麼應用?何況也不知道別人教了它什麼東西,如果教它偏見,它就會有偏見,教它男女不平等,它就會接受男女不平等的觀念;教它不同的宗教信仰,它就會學會不同的宗教信仰。

去年Deep Learning之父傑佛瑞.辛頓(Geoffrey Hinton)、谷歌(Google)資深副總裁等350多位專家連署示警,AI讓人類毀滅危害的風險堪比核戰爭,希望能控制發展。辛頓承認他對AI科技感到有點害怕。

最近奧斯卡得獎影片《奧本海默》,改編自原子彈之父羅伯特奧本海默生平,二次大戰期間,愛因斯坦起草寫一封信,呼籲美國政府要注意德國可能在發展原子彈所以他們必須要急起直追,所以就有曼哈頓計畫。隨著德國和日本投降,被封為原子彈之父的奧本海默,知道自己的發明,成為世界上最邪惡的機器,反對進一步發展核武器,擔心未來成為毀滅世界的武器,因此一直寫信,甚至聯合其他科學家祈求美國政府將此技術非常小心的使用,甚至封存。現在人工智慧的發展情況類似,他們開發的工具,也不能預測未來發展結果會如何?

歐陽明教授說,AI的發展如同電視、廣播和網路一樣,當年有遠東福音電台,對大陸廣播, 現在有好消息電視台,各大教會與機構,也在網路與YouTube主日直播,都是很好的努力;基督徒也可以運用Sora製作動畫聖經或動畫福音故事分享信仰。